第13回 高まるディープフェイクの脅威への対策

この新手の詐欺にはどう備えたらいいか?

鈴木 英夫

慶應義塾大学経済学部卒業。民族系石油会社で、法務部門・ロンドン支店長代行・本社財務課長など(東京・ロンドン)。外資系製薬会社で広報室長・内部監査室長などを務め、危機管理広報・リスクマネジメントを担当(大阪)。現在は、GRC研究所代表・研究主幹、リスクマネジメント&コンプライアンス・コンサルタント(兵庫)。日本経営管理学会会員、危機管理システム研究学会会員。

2026/01/11

新 世界のリスクマネジメントの潮流

鈴木 英夫

慶應義塾大学経済学部卒業。民族系石油会社で、法務部門・ロンドン支店長代行・本社財務課長など(東京・ロンドン)。外資系製薬会社で広報室長・内部監査室長などを務め、危機管理広報・リスクマネジメントを担当(大阪)。現在は、GRC研究所代表・研究主幹、リスクマネジメント&コンプライアンス・コンサルタント(兵庫)。日本経営管理学会会員、危機管理システム研究学会会員。

ディープフェイク*)は登場以来、目新しいフィルターや拡散するいたずら動画といったものから、深刻なビジネスリスクへと急速に変化してきた。2024年だけでも、ディープフェイクを悪用した詐欺によって(企業などの)組織は2億ドル以上の損害を被っており、攻撃者はメールの偽造、音声の複製、ライブビデオ会議の模倣などによって不正送金を誘発し、管理体制を侵害し、ステークホルダーの信頼を失墜させている。

*)注:「ディープフェイク(Deepfake)」とは、AI(人工知能)の技術を使って、実在する人物の顔、声、あるいは動作を別の映像や音声に精巧に合成する技術のこと。「ディープラーニング(深層学習)」と「フェイク(偽物)」を組み合わせた造語で、近年その精度が劇的に向上したことで大きな注目と警戒を集めている。

ディープフェイクのリスクは、攻撃の規模だけでなく、その巧妙さにも起因する。例えば、英国のエンジニアリング会社Arup社の社員は、CFOをはじめとする幹部との正当なビデオ会議を装った詐欺により、複数の香港銀行口座への総額約2500万ドルの送金を承認している。しかし、実際に登場した「幹部」はディープフェイクだったのだ。香港で発生した別の事案では、ある社員が偽の幹部とのビデオ通話に騙されて「要求」に応じ、約2億香港ドル(約2500万ドル:約37億円)相当の送金を15回行なった。

「合成されたインサイダー」と呼ぶものは、サイバー脅威の最新カテゴリーである。これは、AIによって作成された人物で、従業員・パートナー、または幹部に非常によく似ており、見た目・音声・動作が「正確」であるため、従来の認証システムをすり抜けてしまう。

前述のArup社の詐欺事件では、幹部と監査役のディープフェイクアバターを使ったビデオ会議というシナリオ全体に信憑性があったため、従業員は資金移動を承認してしまった。これはネットワークへの侵入ではなく、個人情報の漏洩が起因した。この事件をはじめとする最近の事例は、企業がファイアウォールやエンドポイント保護による境界防御のみに注力するのではなく、個人情報防御・行動検証・生体認証・クロスチャネル認証へと転換する必要があることを示している。法務部門やセキュリティ部門はもはや「内部の者」と見えるものが人間であると想定することはできないのだ。

新 世界のリスクマネジメントの潮流の他の記事

おすすめ記事

失われた危機意識を取り戻す災害図上訓練で自分ごと化 ミツバ

どのメーカー系列にも属さず、複数の自動車メーカーや1次サプライヤーに四輪と二輪用の電装部品を供給する独立系のサプライヤーであるミツバ(群馬県桐生市、日野貞実代表取締役社長)。近年、過去に考えられた災害対策が、途絶えつつあった。同社では“自分ごと化”で従業員の危機意識を高めるため、災害図上訓練を実施。参加者の意欲が高まり、対策用の新たな要望が集まるなど、確実な手応えを感じている。

2026/05/26

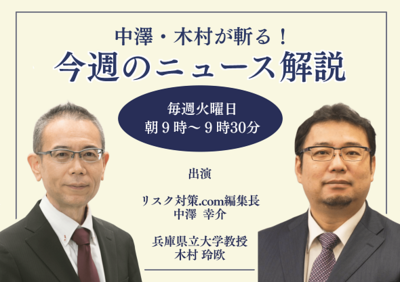

中澤・木村が斬る!今週のニュース解説

毎週火曜日(平日のみ)朝9時~、リスク対策.com編集長 中澤幸介と兵庫県立大学教授 木村玲欧氏(心理学・危機管理学)が今週注目のニュースを短く、わかりやすく解説します。

2026/05/26

顧客の安全と安心をAIと人のアシスタンスサービスで追求

JTBグローバルアシスタンス(東京都千代田区)は、渡航先でのけがや荷物の紛失、言語の壁など、海外旅行に関わるトラブルを包括的にサポートしてきた。昨今では地政学リスクの高まりに応じ、自社の危機管理ソリューションを生かした出張者や駐在員の安全確保にも注力している。創業35年を機に、AIと人間、それぞれの長所を組み合わせたハイブリッド型サービスの展開を目指す。混沌(こんとん)とした時代の中、海外旅行に伴うリスクを低下させ、旅行者の安全をどのように確保するのか。鈴木章敬代表取締役社長に話を聞いた。

2026/05/19

※スパム投稿防止のためコメントは編集部の承認制となっておりますが、いただいたコメントは原則、すべて掲載いたします。

※個人情報は入力しないようご注意ください。

» パスワードをお忘れの方