2018/11/22

AIブームとリスクのあれこれ

■AIが生む偏見や差別

AIを使ったディープフェイクビデオ(「第4回:証拠映像ですら「証拠」と見なされなくなる時代」を参照)が、個人だけでなく国家にも脅威を与える可能性があることを以前この連載で書きましたが、AIを使えばSNSでも何やらインパクトのあることができてしまうようです。

マイクロソフトが考案したAIプログラムがその好例です。このプログラム(ボットと呼ばれている)にツイッターのアカウントを与えたところ、ヒトラーや白人至上主義の支持者による不快な投稿を学習するのに1日もかからなかったというのです。もっとも寛容な目で見れば、AIならこんなこともできてしまうんだ…とちょっとしたエピソードで終わってしまう話ではありますが。

しかし研究者や開発者たちから見れば、AIが偏見を持つようにふるまうことがわかった以上、これは看過できない問題でしょう。とりわけ顔認証や言語理解などを目的としたAI技術のクオリティに大きく関わることでもあるからです。黒人や東洋人よりも白人の顔の方をより好ましいと判断したり、日本語よりも英語を話す市民の方がサービスを受けやすくなるといったこと。考えればきりがありませんが、とても不快なことではあります。

AIを、偏見を持たない客観的で理性的な存在にするにはどうすればよいのでしょうか。専門家は、それは特定の人種や性別やセクシュアリティを支持するバイアスをなくすことだと指摘します。大手IT企業の中には、AIによる差別や偏見を取り除く研究をしているところもあります。AIベースの顔認証システムにおける肌その他の顔の属性をできる限りたくさん集めたデータセットを実装してバイアス(偏見)を低減するのだそうですが、果たしてどこまで可能になるのでしょうか。

AIブームとリスクのあれこれの他の記事

おすすめ記事

-

リスク対策.PROライト会員用ダウンロードページ

リスク対策.PROライト会員はこちらのページから最新号をダウンロードできます。

2026/05/05

-

-

中澤・木村が斬る!今週のニュース解説

毎週火曜日(平日のみ)朝9時~、リスク対策.com編集長 中澤幸介と兵庫県立大学教授 木村玲欧氏(心理学・危機管理学)が今週注目のニュースを短く、わかりやすく解説します。

2026/04/28

-

-

-

サプライチェーン対策「行っていない」が49.7%~BCP策定状況は頭打ち、実効性に課題~

内閣府は、令和7年度における「企業の事業継続及び防災の取組に関する実態調査」についての結果を発表した。2007年度から隔年で実施しているもので前回の令和5年度時点での調査以来となる。それによると、近年災害時などで課題になっているサプライチェーンの対策について、「サプライチェーン強靭化への取組を行っているか」との設問に対し、「行っていない」が49.7%と最も高く、次いで「行っている」が25.9%、「現在検討中」が20.7%となった。

2026/04/26

-

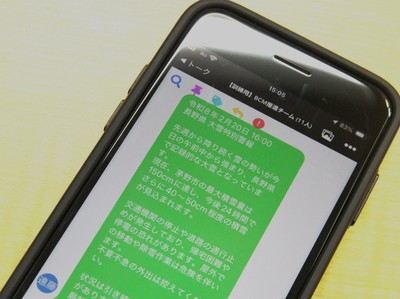

スマホ通知が号令、災害の初動対応訓練を開発

半導体製造装置大手の株式会社ディスコ(東京都大田区)は、平時のコミュニケーションツールを使ったさまざまな危機事案に対応できる初動対応訓練の仕組みを開発し、実践を続けている。メンバーが、危機を発生させる運営チームと対応チームに分かれ、業務中に突発的に危機事案を模擬的に発生させるとともに、通知を受け取ったチームは、即座に、訓練を開始する。リアリティーを追求した結果、たどり着いた手法だ。

2026/04/20

-

-

-

![2022年下半期リスクマネジメント・BCP事例集[永久保存版]](https://risk.ismcdn.jp/mwimgs/8/2/160wm/img_8265ba4dd7d348cb1445778f13da5c6a149038.png)

※スパム投稿防止のためコメントは編集部の承認制となっておりますが、いただいたコメントは原則、すべて掲載いたします。

※個人情報は入力しないようご注意ください。

» パスワードをお忘れの方